この記事では Snowflake vs BigQuery のどちらを選ぶべきか、料金・性能・運用・エコシステム・チーム適性の5軸で判断するための具体的基準を提示します。検索でたどり着いた方が「結局どっち?」の答えにすぐたどり着けるよう、結論早見表から先に出します。Snowflake BigQuery 比較で迷っているなら、まずこの先のマトリクスを眺めてください。

結論早見表 ― 時間がない人向けの選定マトリクス

先に結論です。下の表で自分のシナリオに近い行を見て、推奨カラムを採用すれば9割は外しません。Snowflake BigQuery 違いの判断軸はだいたいこの12シナリオに集約されます。

| シナリオ | 推奨 | 理由(一言) |

|---|---|---|

| Google広告/GA4/Firebaseが分析の主役 | BigQuery | 無料エクスポートと統合の手間ゼロ |

| 大規模ストリーミング集計(秒単位の鮮度) | BigQuery | Streaming Insertsとマテビューが強い |

| 複雑BI(数百ダッシュボード・同時実行) | Snowflake | マルチクラスタで詰まらない |

| パートナー企業に生データを共有 | Snowflake | Secure Data Sharingが圧倒的に楽 |

| Marketplaceで外部データを買って分析 | Snowflake | マーケットプレイス成熟度が一段上 |

| AWS+Azureなどマルチクラウド要件 | Snowflake | BigQueryはGCP固定 |

| GCPに既に組織が乗っており他は使わない | BigQuery | IAM/VPC/監査がGoogle側で一気通貫 |

| スポット利用・月数十万円以下の小規模 | BigQueryオンデマンド | 使った分だけ、待機コスト無し |

| 定常的な重ELT・夜間バッチ大量実行 | Snowflake / BigQuery Editions | 定額枠で予測可能 |

| SQLだけでLLM/生成AIを試したい | 互角(用途で選ぶ) | Cortex vs BigQuery ML+Vertex |

| 非エンジニアが直感的にデータアプリ化 | Snowflake | Streamlit in Snowflakeが手軽 |

| Lookerで全社BIを統一 | BigQuery | Looker側のチューニング前提が揃う |

正直に言うと、この表は「決定打が一つもない案件」では役に立ちません。その場合は後半の選び方チェックリストとPoC手順を使ってください。

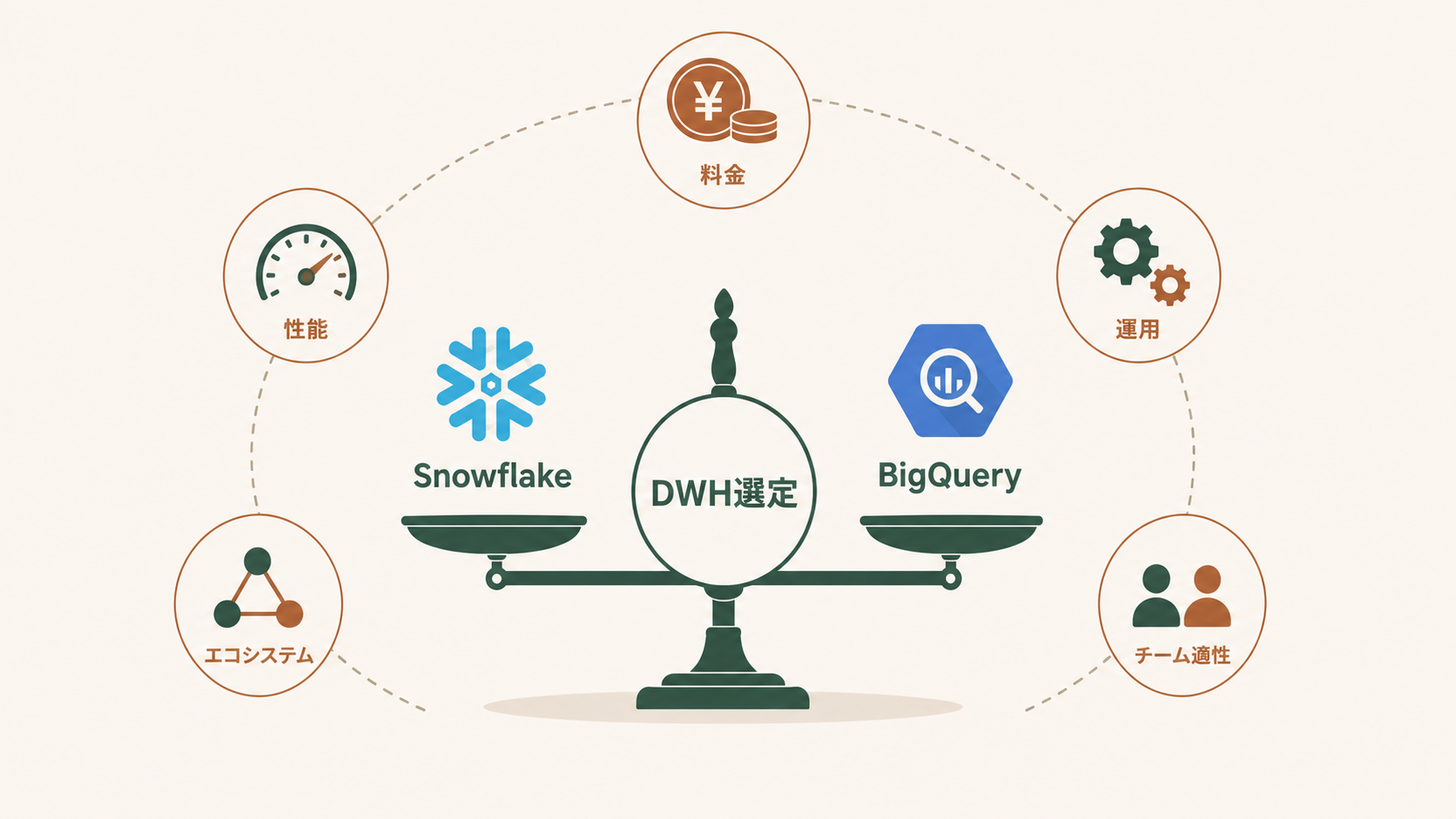

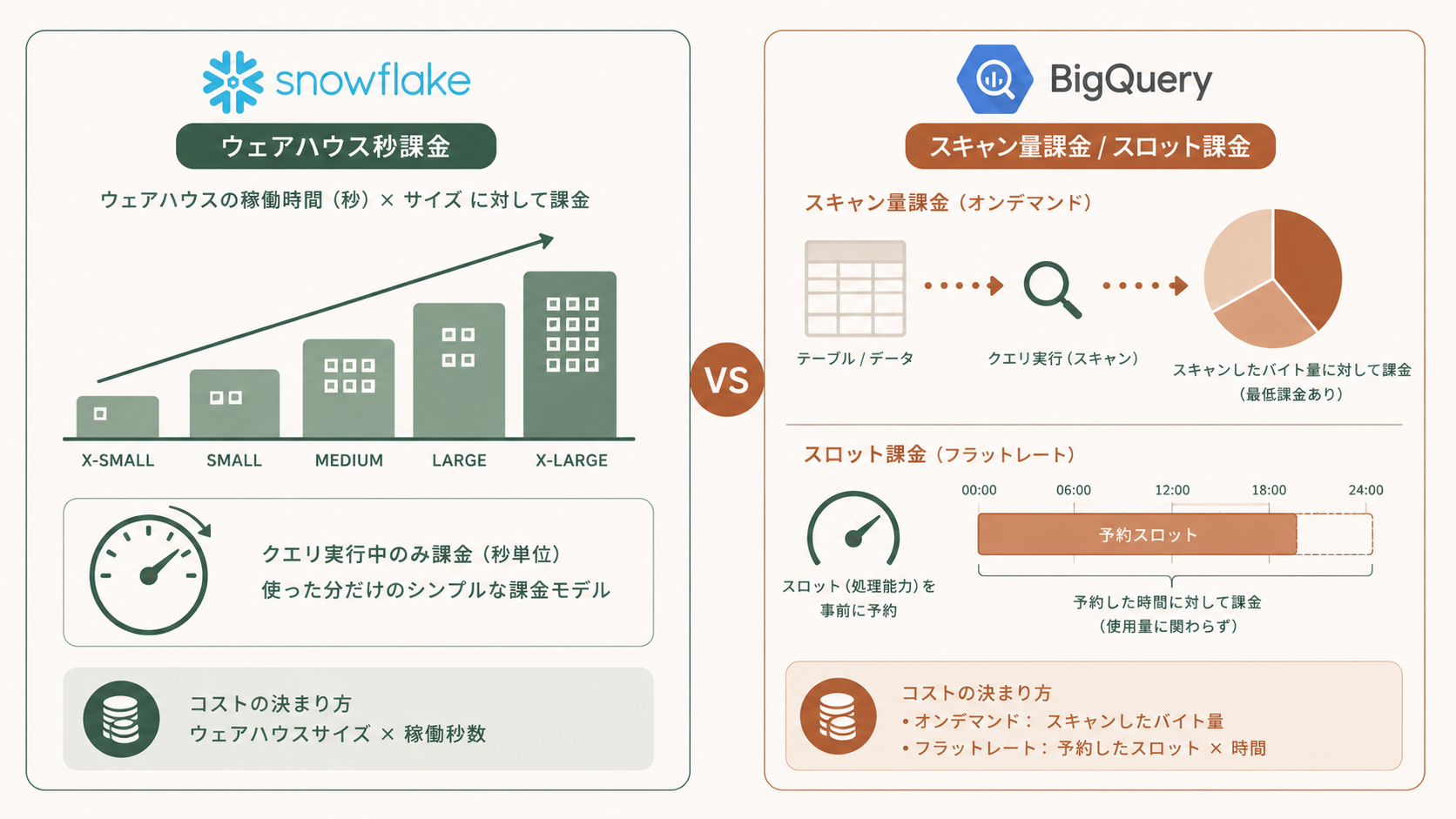

料金モデルの違い ― 課金単位がそもそも別物

両者で一番ややこしいのが料金モデルです。同じ「DWH」と括られますが、課金単位の発想が根本的に違います。

Snowflakeの課金: ウェアハウス × 起動秒数 × 単価

Snowflakeはウェアハウス(コンピュート)を起動している秒数でクレジット課金されます。ウェアハウスサイズ(XS/S/M/L/XL…)が倍々でクレジット消費も倍々。さらにエディション(Standard / Enterprise / Business Critical)とクラウド・リージョンでクレジット単価が変わる三層構造です。ストレージは別課金で、圧縮後容量に対してTB単価。

落とし穴はAUTO_SUSPENDのデフォルトが600秒(=10分)になっているケースで、アドホック分析だと10分間ずっとアイドル課金が発生します。私のチームでは全ウェアハウスを60秒に揃える運用ルールにして、月のクレジットが2割落ちました。詳細はSnowflakeウェアハウス使用状況の可視化とコスト最適化入門に書いています。

BigQueryの課金: オンデマンド vs Editions

BigQueryは2つのモードがあります。

- オンデマンド: クエリがスキャンしたバイト数で課金($6.25/TB前後、リージョン依存)。月1TB無料枠あり。

- Editions(Standard/Enterprise/Enterprise Plus): スロット時間で予約購入。Autoscalerで増減可能。

「BigQueryは1TB無料だから安い」は半分罠です。SELECT * を書く文化のチームに渡すと、無料枠は1日で吹き飛びます。公式ドキュメントには書いていないですが、私の感覚ではアドホック分析人数が10人を超えたあたりからEditionsへの移行を検討した方が安定します。

月額レンジの目安(私が見てきた範囲)

規模 Snowflake BigQuery

小規模 5〜15万円/月 0〜8万円/月(オンデマンド)

中規模 30〜80万円/月 30〜70万円/月(Editions)

大規模 200万円〜 150万円〜(Enterprise+予約)あくまで「肌感」です。クエリパターン次第で倍以上ぶれます。重要なのは小規模ではBigQueryオンデマンドが圧勝しがちで、中規模以降は意外と差がなくなる点です。

パフォーマンスの違い ― 得意なクエリが違う

ベンチマーク表は条件次第でいくらでも操作できるので、ここでは「どんなクエリで何が起こるか」の傾向を書きます。

キャッシュの効き方

Snowflakeは結果セットキャッシュ・ウェアハウスローカルSSDキャッシュ・メタデータキャッシュの3層で、特に同じダッシュボードを何度も叩く運用ではウェアハウスを起こした直後のクエリより、温まった後のクエリが体感倍速になります(詳細はSnowflakeの3つのキャッシュの違い参照)。BigQueryは結果キャッシュは効きますが、コンピュート側のローカルキャッシュという概念がほぼ無いので、同じクエリを何度叩いても初回と同じくらい時間がかかる印象です。

スキャン量の予測性

BigQueryの「クエリ実行前にスキャン量が分かる」のは正直うらやましい機能です。Snowflakeは実行してみるまでクレジット消費が読めない。BIユーザーが暴走クエリを書いた時、BigQueryなら事前見積もりで止められますが、Snowflakeはリソースモニターでウェアハウス停止になってから気づくケースが多いです。

同時実行のスケール戦略

同時実行ユーザーが100人を超えたら、戦略がはっきり分かれます。Snowflakeはマルチクラスタウェアハウスでクラスタを横に増やす(クエリ詰まりが発生したら自動で2号機3号機を起動)。BigQueryはスロットプールから動的に切り出すモデルで、Editionsのオートスケール上限を高く設定しておけば自然にさばけます。私の体感では、BIワークロードはSnowflakeのマルチクラスタの方が読みやすく、ストリーミング+大量小クエリはBigQueryの方が落ち着く印象です。

JOIN性能とETLの書きやすさ

10億行 × 10億行のJOINは、どちらもまあ普通に終わります。差が出るのは「分散しづらいJOIN(高カーディナリティのキーの偏り)」で、Snowflakeはウェアハウスサイズを上げると素直に速くなる傾向、BigQueryはスロット数を増やしてもキーの偏りには勝てないことがあります。ELTの書きやすさはdbt前提ならほぼ互角ですが、SQLだけでウィンドウ関数をフィルタする QUALIFY は両方で使えるようになっており、最近は記述差がだいぶ縮みました。

同じ集計をSQLで書くと?

-- Snowflake

SELECT user_id, event_date, revenue

FROM analytics.public.orders

QUALIFY ROW_NUMBER() OVER (PARTITION BY user_id ORDER BY event_date DESC) = 1;

-- BigQuery (フルパス参照 + バッククォート)

SELECT user_id, event_date, revenue

FROM `my-project.analytics.orders`

QUALIFY ROW_NUMBER() OVER (PARTITION BY user_id ORDER BY event_date DESC) = 1;違いはスキーマ参照の流儀(db.schema.table vs project.dataset.table)とバッククォートの有無くらい。日付関数や配列関数は別物なので、移行時に書き換えが必要なのは主にそこです。

データ取り込みと連携 ― ここで土俵が分かれる

Snowflake側

COPY INTO(バルクロード)、Snowpipe(ファイル到着トリガで自動取り込み)、Streams + Tasks(変更データキャプチャと定期実行)が三種の神器。Salesforce、Slack、外部SaaSのコネクタはFivetran/Airbyte前提でほぼ何でも繋がります。Marketplace経由で他社のテーブルを「自社DBにあるかのように」読めるのは Snowflake にしかない体験で、これは SnowflakeセキュアデータシェアリングとSnowflake Marketplaceの組み合わせで実現します。

BigQuery側

Streaming Inserts(秒単位投入)、BigQuery Data Transfer Service(GA・広告系の定期取り込み)、Dataflow(本格パイプライン)が中心。GA4・Google広告・Search Console・Firebase は実質コーディングなしで取り込めるのが圧倒的優位です。私が前職で広告ログ集計をBigQueryでやっていた最大の理由はこれで、Snowflakeでこれを再現するなら有償ETLツール代だけで月20万円ほど追加で必要でした。

結論をひとことで言うと、Google広告/GA/Firebaseが主役 → BigQuery、SaaSデータと社外共有が主役 → Snowflake。逆を選ぶと連携工数が地味に効いてきます。

運用・権限管理の違い ― RBAC vs IAM

SnowflakeのRBAC

Snowflakeはロールベースアクセス制御(RBAC)で、ロールを継承させて階層を作れます。たとえば ANALYST_BASE → ANALYST_FINANCE → ANALYST_FINANCE_LEAD のように積み上げて、上位ロールで下位の権限を全部使える。組織のロール表現力は明らかにSnowflakeの方が高いです。

BigQueryのIAM

BigQuery側は Google Cloud IAM そのもので、プロジェクト/データセット/テーブル(/列)にロールを割り当てます。Google Workspaceのグループと直結するので、人事異動でメールが消えれば自動的に権限も消える運用が組めるのは強み。ただしロールの「継承して合成」みたいな表現はやりにくい。

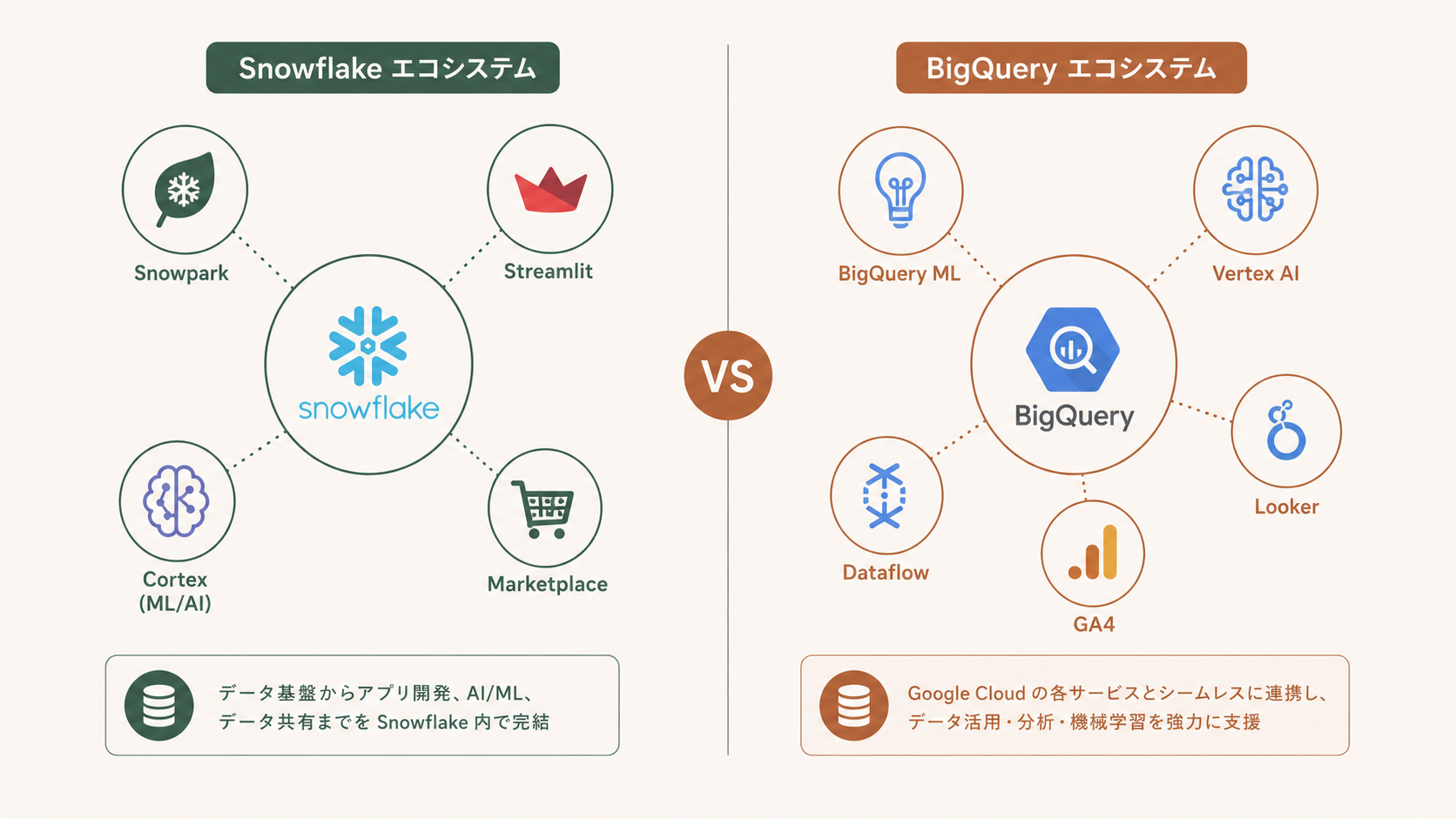

エコシステム・将来性 ― AI方向の動きが活発

Snowflake側のAI/開発

- Snowpark: Python/Java/ScalaでDataFrame処理をSnowflake内で実行

- Streamlit in Snowflake: PythonアプリをSnowsightで配布(こちらの記事でも触れました)

- Snowflake Cortex: SQLから直接LLMを呼び出せる関数群(SUMMARIZE、SENTIMENT、COMPLETEなど)

- Marketplace: 他社データ・LLMモデル・ネイティブアプリの流通市場

BigQuery側のAI/開発

- BigQuery ML: SQLだけで線形回帰・XGBoost・時系列予測まで書ける

- Vertex AI 連携: Geminiモデルを

ML.GENERATE_TEXTで呼び出し - Looker / Looker Studio との一体感: ダッシュボード側からのドリルダウン体験が滑らか

正直、AIワークロードはどちらも追いかけっこです。「SQLでLLM呼ぶ」だけならBigQueryの方が一日の長(Geminiが直で叩ける)、「データアプリを社内配布する」ならSnowflake(Streamlit in Snowflakeが圧倒的に楽)、というのが2026年5月時点の私の見立てです。

選び方チェックリスト ― Yes/Noで絞り込む10項目

自社シナリオに当てはめてYesを数えてください。

[ ] 1. Google広告/GA4/Firebaseが分析対象の主軸である? → Yes:BigQuery傾向

[ ] 2. AWS or Azure 上のサービスとデータ連携が前提? → Yes:Snowflake傾向

[ ] 3. パートナー企業へリアルタイムでデータ提供したい? → Yes:Snowflake傾向

[ ] 4. SQL書ける人が10人未満で、月コストを最小化したい? → Yes:BigQueryオンデマンド

[ ] 5. ダッシュボード閲覧者が日次で数百人規模? → Yes:Snowflakeマルチクラスタ

[ ] 6. dbt + GitHub Actions で ELT を回したい? → Yes:両方OK(差なし)

[ ] 7. 既に組織がGoogle Workspace全社導入済み? → Yes:BigQuery傾向(IAM一気通貫)

[ ] 8. 列レベル/行レベルのきめ細かい権限制御が必須? → Yes:Snowflake傾向

[ ] 9. SQLだけで生成AI(LLM)を業務に組み込みたい? → Yes:互角(検証必須)

[ ] 10. データ基盤の「定額化」を経営から求められている? → Yes:Snowflakeエディション or BigQuery Editions

FAQ

SnowflakeとBigQueryの料金は結局どちらが安い?

「使い方による」が真の答えですが、傾向としては小規模アドホック中心ならBigQueryオンデマンドが安く、定常的に重い処理を回すならSnowflake or BigQuery Editionsが横並びです。スキャン量が読めないクエリを大量に叩くチームではBigQueryオンデマンドが青天井になりやすいので注意。

BigQueryからSnowflakeへ移行するコストは?

SQLそのものの書き換えは2〜3割で、UDF・日付関数・配列関数の差分対応が大半。問題はパイプライン側で、Dataflow / Cloud Composer で組んだETLを Snowpipe + Tasks に置き換える工数の方が重いです。

SnowflakeでGoogle広告/GA4のデータを扱える?

扱えますが直結はできません。Fivetran/Airbyte/StitchなどのSaaS ETL経由が現実解で、月数万円〜の追加コストが発生します。GA4の生イベントログを丸ごと取り込みたい場合は、一度BigQueryにエクスポート → Snowflakeへ転送、という二段構えにすることもあります。

データエンジニア未経験ならどちらから学ぶべき?

個人で学ぶならSnowflakeの30日無料トライアルが最短です。クレジットカード不要、Snowsightで完結、ロールやウェアハウスといった「クラウドDWHの本質的な概念」が手に動きます。BigQueryはGCPアカウント作成→課金紐付けの手間があり、最初の一歩が重い。

SnowPro認定資格とGoogle Cloud資格、どちらが転職に強い?

2026年5月の日本市場では、求人数はGoogle Cloud Professional Data Engineerの方が多いものの、「Snowflakeを本番で触れる人」の希少性は格段に高く、実務年収レンジはSnowflake経験者の方が高い印象です。資格そのものより実プロジェクト経験が問われます。SnowPro Coreは1週間で取れるレベルなので、まずこちらを取りつつ実務経験を積むのが投資効率は良い(私の体験談はSnowPro Coreに1週間で合格に書いています)。

迷ったらこの順で検証してください ― PoC 3ステップ

最後に、机上比較で決まらなかった時の検証手順を置いておきます。

- ステップ1: 自社の最重コスト要件を1つだけ決める。「月額固定で予算化したい」なのか「ピーク時の同時実行を捌きたい」なのか「外部共有のスピードか」。複数選ばないこと。

- ステップ2: 両方で同じデータセットを2週間動かす。本番代表クエリTOP10をdbtで両DWHに同時にデプロイし、ACCOUNT_USAGEとBigQueryのINFORMATION_SCHEMA.JOBSで実コストを並べる。机上見積もりは外れます。

- ステップ3: 運用負荷を数値化する。権限申請から実際のクエリ実行までの平均時間、ETL障害の復旧時間、新規ユーザーのオンボーディング時間。コストよりこちらで差がつくケースがほとんどです。

参考リンク

関連記事

- Snowflakeウェアハウス使用状況の可視化とコスト最適化入門 – AUTO_SUSPENDの落とし穴を含むコスト最適化の実務手順

- Snowflakeクレジット消費を分析|ACCOUNT_USAGEビュー入門 – PoCで実コストを並べる時に必須のビュー解説

- Snowflakeマルチクラスタウェアハウス入門 – BIワークロードの同時実行戦略

- Snowflakeの3つのキャッシュの違い – パフォーマンス比較で押さえる前提知識

- Snowflake Marketplace入門 – データ共有エコシステムの実体験

- Snowflakeセキュアデータシェアリング入門 – パートナー企業共有がBigQuery比で楽な理由

- Streamlit in Snowflake入門 – エコシステム章で言及したデータアプリ機能

- Snowflake RBAC入門 – 権限設計でBigQuery IAMと比較する前提

- SnowPro Coreに1週間で合格 – 学習コスト比較で触れた資格の体験記